あなたがリベラルか保守(左か右か)かはすでにAIが顔写真から判定できるようです。思想の自由や心のプライバシーといった基本的人権について、真剣に議論を始めなければならない段階にすでに来ています。

英科学誌「サイエンティフィックリポーツ」で2021年1月に発表されたMichal Kosinski氏の研究では、Facebookなど100万人の顔写真を用いてAIに政治指向性を予測させたところ、72%の確率でリベラルか保守かを正しく判定できたようです。

AI(人工知能)技術の光と闇

AIテクノロジーは私たちの生活を便利で豊かにする可能性を持つ一方で、悪用/誤用された場合は、監視、差別、その他の危険をはらんでいます。

AI・顔認証大国中国の現状

参考動画|VICE News:中国の顔認識監視の現状。信号無視者の特定、飲食店での注文、公衆トイレ、施設入場など生活のあらゆる領域で普及しているが、中国では政府がどの程度の個人情報を収集できるかについて制約はないとのこと。

参考動画|教育現場でも様々なAI技術が導入されている。チップ入りの制服での位置情報追跡、教室内の監視カメラによるスマホ閲覧やあくびの頻度チェック、子供たちが集中しているかどうか脳波のデータによる監視など。

※脳波を利用したテクノロジーについては次の過去記事でも紹介しています。

AIは顔画像からどんな個人情報を読み取れるのか?

顔画像からAIが予測できる情報としては、性別・年齢・民族・感情の状態だけでなく、性的指向(Wang, Y. & Kosinski 2018)や性格(Kachur, A. et al., 2020)も報告されています。

これらに加えて、本研究では顔画像から政治的指向も予測できることが明らかになりました。

顔写真から政治的指向の判定に成功

今回、Michal Kosinski氏の研究では、Facebookやオンラインデートサイトなどから集めた約100万人の画像を使って、AI(機械学習)にリベラル派か保守派かを判定させました。

アメリカ・イギリス・カナダの3か国の人々の写真が使われましたが、多様な人種が含まれていたため、今回の結果は様々な国や文化の人にも適応できるだろうとのことです。

被験者は政治指向を自己申告し、一部の人は性格診断のようなものにも回答したようです。

※クレジット:以下の図はMichal Kosinski氏の研究(CC)より引用

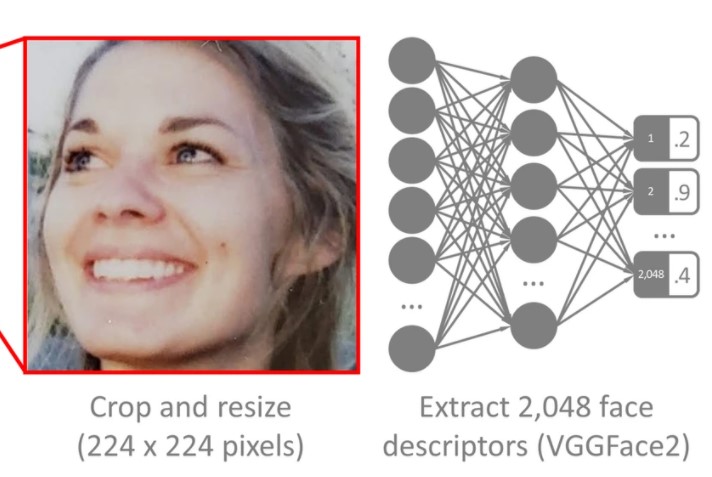

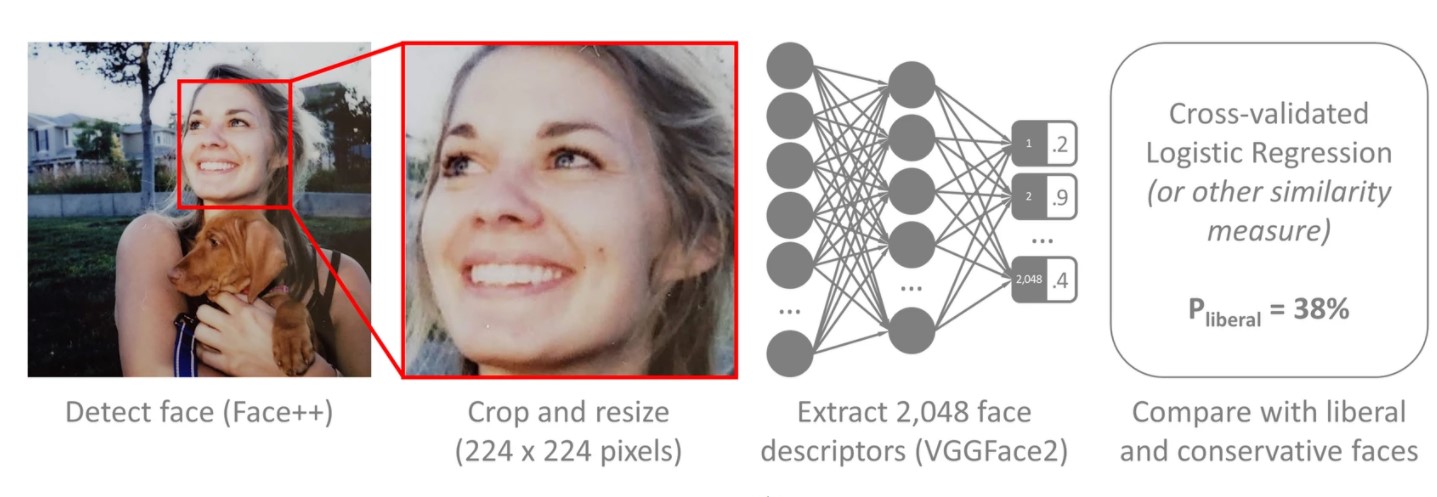

↑今回の予測に用いられた手順。写真から顔の部分を切り取ったのち、顔の特徴を抽出し、平均的なリベラル派 / 保守派の顔と比較したようです。

どれくらい正確に判定できたか?(精度・結果)

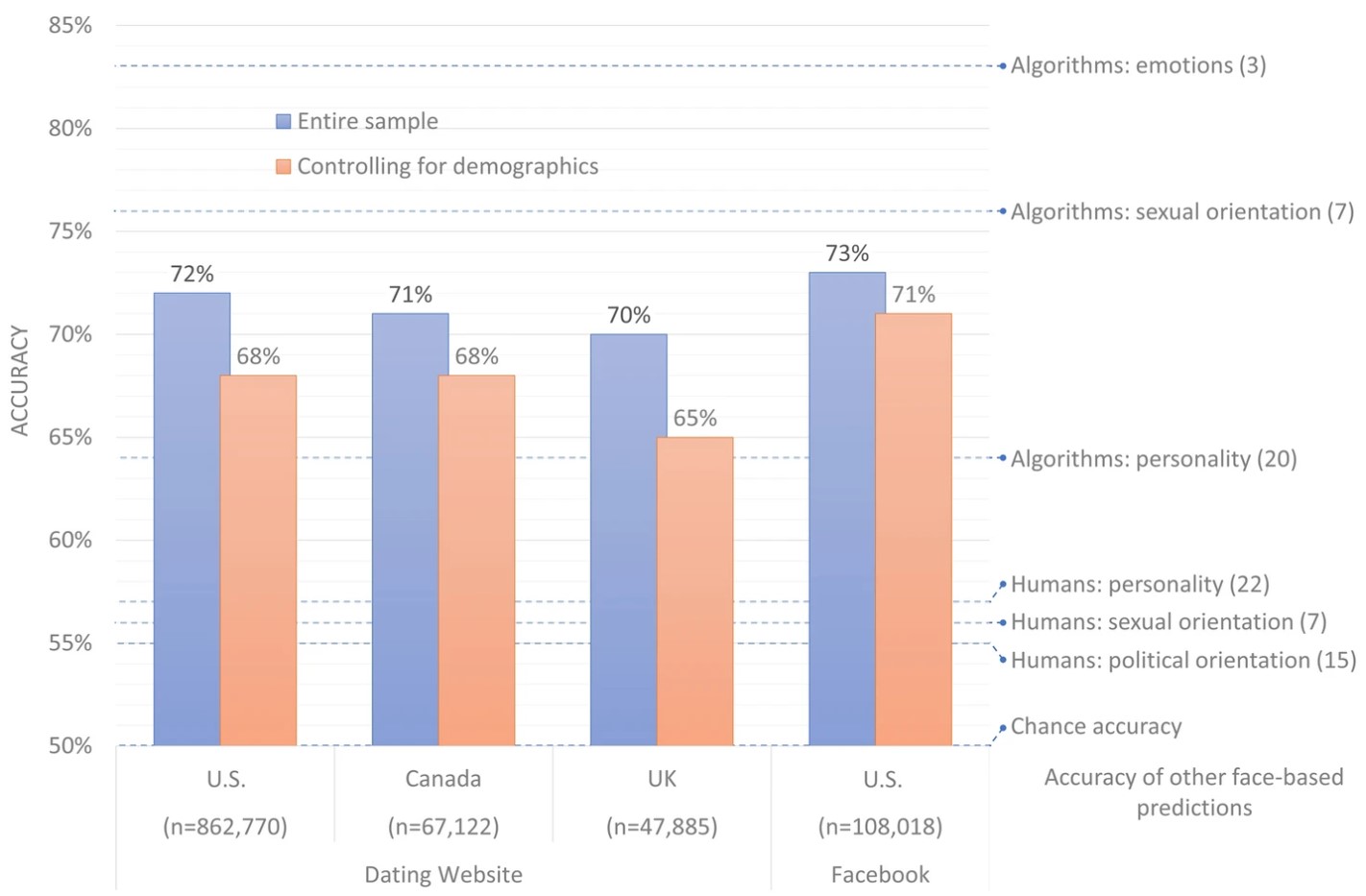

↑サンプル数が最大のアメリカのデートサイトの顔写真では、72%の精度でリベラル派と保守派を判別できたようです(ランダムなら50%、人間が判定した場合は55%)。右には別な研究の参考値として政治指向以外にも感情(emotions)、性的指向(sexual orientation)、性格(personality)の精度もAI(Algorithms)と人間(Humans)それぞれ記載されています。

顔の各特徴や性格と判定精度の関係

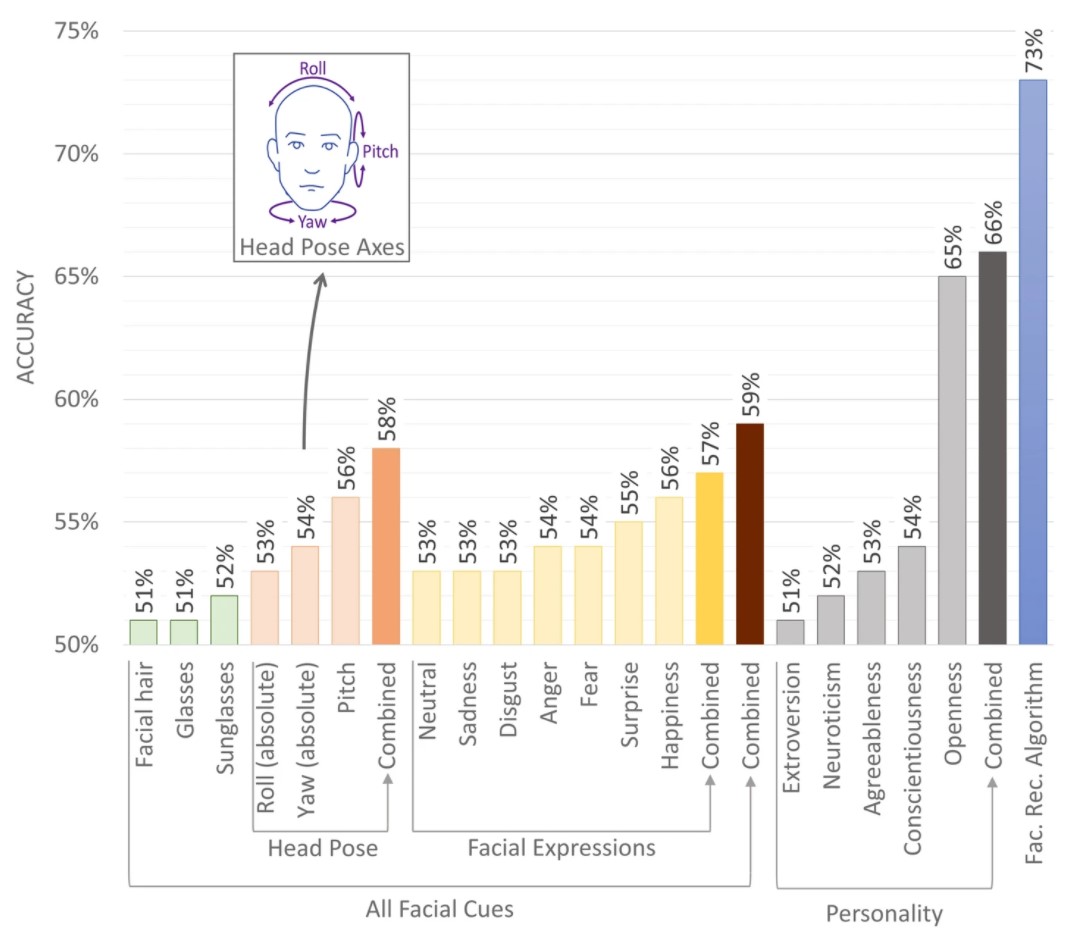

↑開放的な性格などでもある程度判定できたようですが、それでも性格全体の情報や個々の顔の特徴を合わせたものよりも、1枚の顔写真の方がより高い精度で政治指向を判定できたようです。

↑開放的な性格などでもある程度判定できたようですが、それでも性格全体の情報や個々の顔の特徴を合わせたものよりも、1枚の顔写真の方がより高い精度で政治指向を判定できたようです。

新たな監視社会とどう向き合うべきか?

今回の結果から、論文の著者はプライバシーや自由な人権の侵害・選挙活動への不正利用などを懸念しています。学者、政治家、エンジニア、一般市民のいずれもが、こうしたAI技術の使い方や問題についてよく考えて議論することが大切でしょう。

法律的な整備を含めて、色々な動きがあるようです。

参考動画|TED:顔認証による監視について私たちが知るべきこと(日本語字幕あり)

参考動画|WIRED.jp:監視社会を「飼いならされた監視」「共生的監視」として受け入れるという捉え方もあるようです。

【管理人チャールズの感想】

テクノロジーの急速な進歩とコロナ社会情勢の急激な変化の中にある現在、私たちはこれから人間としてどのように生きていくべきか、重要な分岐点に立っているのかもしれません。

以下の記事でもAIやテクノロジーについて取り上げています。

コメント